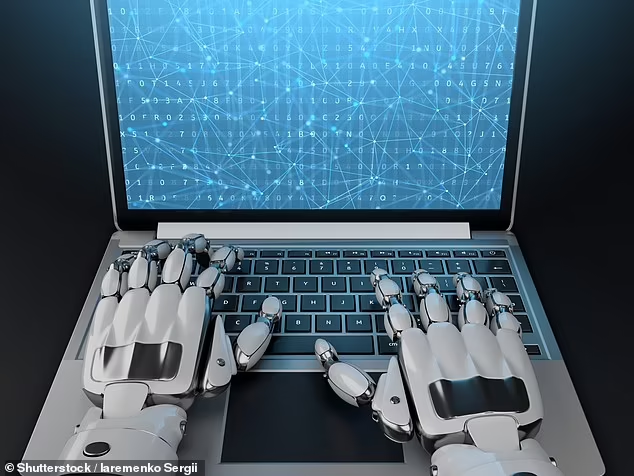

AI ChatGPT dapat Dengan Mudah Diprogram Oleh Anak Muda untuk Meluncurkan Serangan Teror

Berita Baru, Internasional – Chatbot AI dengan kecerdasan buatan dapat segera mempersiapkan para ekstremis untuk melancarkan serangan teroris, demikian peringatan dari peninjau independen undang-undang terorisme.

Dilansir dari Dailymail.co.uk pada 20 April, Jonathan Hall KC mengatakan kepada Media pada hari Minggu bahwa bot seperti ChatGPT dapat dengan mudah diprogram, atau bahkan memutuskan sendiri, untuk menyebarkan ideologi teroris ke ekstremis yang rentan, menambahkan bahwa ‘serangan yang didukung AI mungkin akan terjadi’.

Mr Hall juga memperingatkan bahwa jika seorang ekstremis dipersiapkan oleh chatbot untuk melakukan kekejaman teroris, atau jika AI digunakan untuk menghasutnya, mungkin sulit untuk mengadili siapa pun, karena undang-undang kontra-terorisme Inggris belum mengikuti aturan baru. teknologi.

Mr Hall berkata: “Saya percaya sepenuhnya dapat dibayangkan bahwa AI chatbots akan diprogram atau, lebih buruk lagi, memutuskan untuk menyebarkan ideologi ekstremis dan kekerasan.”

“Tapi ketika ChatGPT mulai mendorong terorisme, siapa yang akan dituntut?”

“Karena hukum pidana tidak mencakup robot, AI groomer akan bebas dari hukuman. Juga tidak [hukum] bekerja dengan andal ketika tanggung jawab dibagi antara manusia dan mesin.”

Mr Hall khawatir bahwa chatbots bisa menjadi ‘anugerah’ bagi apa yang disebut teroris serigala penyendiri, dengan mengatakan bahwa ‘karena pendamping buatan adalah anugerah bagi yang kesepian, kemungkinan banyak dari mereka yang ditangkap akan menjadi neurodivergent, mungkin menderita gangguan medis. , ketidakmampuan belajar atau kondisi lain’.

Dia memperingatkan bahwa ‘terorisme mengikuti kehidupan’, jadi ‘ketika kita bergerak online sebagai masyarakat, terorisme bergerak online’. Dia juga menunjukkan bahwa teroris adalah ‘pengadopsi teknologi awal’, dengan contoh terbaru termasuk ‘penyalahgunaan senjata cetak 3D dan cryptocurrency’.

Mr Hall mengatakan tidak diketahui seberapa baik perusahaan yang menjalankan AI seperti ChatGPT memantau jutaan percakapan yang terjadi setiap hari dengan bot mereka, atau apakah mereka memberi tahu agen seperti FBI atau Polisi Penanggulangan Terorisme Inggris terhadap sesuatu yang mencurigakan.

Meskipun belum ada bukti yang muncul bahwa bot AI telah mempersiapkan siapa pun untuk terorisme, ada cerita tentang mereka yang menyebabkan kerusakan serius. Seorang ayah dua anak Belgia bunuh diri setelah berbicara dengan bot bernama Eliza selama enam minggu tentang kekhawatirannya terhadap perubahan iklim. Seorang walikota di Australia telah mengancam akan menuntut OpenAI, pembuat ChatGPT, setelah mengklaim bahwa dia telah menjalani hukuman penjara karena penyuapan.

Baru akhir pekan ini terungkap bahwa Jonathan Turley dari Universitas George Washington di AS secara keliru dituduh oleh ChatGPT melakukan pelecehan seksual terhadap seorang siswi selama perjalanan ke Alaska yang tidak dia lakukan. Tuduhan itu ditujukan kepada seorang rekan akademisi yang sedang meneliti ChatGPT di universitas yang sama.

Komite Sains dan Teknologi Parlemen sekarang sedang melakukan penyelidikan terhadap AI dan tata kelola.

Ketuanya, Tory MP Greg Clark, berkata: “Kami menyadari ada bahaya di sini dan kami perlu mengatur tata kelola dengan benar. Ada diskusi tentang anak muda yang dibantu menemukan cara untuk bunuh diri dan teroris yang dipersiapkan secara efektif di internet. Mengingat ancaman tersebut, sangatlah penting bagi kami untuk mempertahankan kewaspadaan yang sama terhadap konten otomatis yang dibuat bukan oleh manusia.”

Raffaello Pantucci, seorang ahli kontra-terorisme di think tank Royal United Services Institute (RUSI), mengatakan: “Bahaya dengan AI seperti ChatGPT adalah dapat meningkatkan ‘teroris aktor tunggal’, karena akan memberikan perlindungan yang sempurna bagi seseorang. mencari pemahaman sendiri tetapi khawatir tentang berbicara dengan orang lain.”

Mengenai pertanyaan apakah perusahaan AI dapat dimintai pertanggungjawaban jika seorang teroris melancarkan serangan setelah dipersiapkan oleh bot, Mr Pantucci menjelaskan: ‘Pandangan saya agak sulit untuk menyalahkan perusahaan, karena saya tidak sepenuhnya yakin mereka mampu mengendalikan mesin itu sendiri.’

ChatGPT seperti semua ‘keajaiban’ online lainnya akan disalahgunakan untuk tujuan terorisme, pengawas teror memperingatkan

Oleh Jonathan Hall KC Peninjau Independen Legislasi Terorisme

Kami telah di sini sebelumnya. Lompatan teknologi yang segera membuat kita terpikat.

Kali ini adalah ChatGPT, chatbot kecerdasan buatan yang tersedia secara gratis, dan para pesaingnya.

Mereka tidak terasa seperti aplikasi lain, tetapi cara baru yang menarik untuk berhubungan dengan komputer kita dan internet yang lebih luas.

Namun, yang paling mengkhawatirkan, penggunaannya tidak hanya terbatas pada membuat profil kencan yang sempurna atau menyusun rencana perjalanan liburan yang ideal.

Apa yang diketahui dunia dari dekade terakhir adalah bahwa terorisme mengikuti kehidupan.

Jadi, saat kita bergerak online sebagai masyarakat, terorisme juga bergerak online; ketika chatbot yang cerdas dan pandai berbicara tidak hanya menggantikan mesin pencari internet tetapi juga menjadi sahabat dan panduan moral kita, worm teroris akan menemukan jalannya.

Tetapi pertimbangkan ke mana jalan bata kuning dari niat baik, pedoman komunitas, tim kecil moderator, dan mekanisme pelaporan. Ratusan juta orang di seluruh dunia dapat segera mengobrol dengan teman buatan ini selama berjam-jam, dalam semua bahasa di dunia.

Saya percaya bahwa sangat mungkin bahwa chatbot Kecerdasan Buatan (AI) akan diprogram, atau bahkan lebih buruk lagi, memutuskan untuk menyebarkan ideologi ekstremis kekerasan dalam satu naungan atau lainnya.

Undang-undang anti-terorisme sudah ketinggalan ketika datang ke dunia online: tidak dapat menjangkau aktor luar negeri yang memfitnah atau pendukung teknologi.

Tetapi ketika ChatGPT mulai mendorong terorisme, siapa yang akan dituntut?

Pengguna manusia dapat ditangkap karena apa yang ada di komputer mereka, dan berdasarkan beberapa tahun terakhir, banyak dari mereka adalah anak-anak. Juga, karena pendamping artifisial adalah anugerah bagi yang kesepian, kemungkinan banyak dari mereka yang ditangkap akan mengalami neurodivergen, mungkin menderita kelainan medis, ketidakmampuan belajar, atau kondisi lainnya.

Namun karena hukum pidana tidak mencakup robot, AI groomer akan bebas dari hukuman. Juga tidak beroperasi dengan andal ketika tanggung jawab dibagi antara manusia dan mesin.

Sampai saat ini, penggunaan komputer oleh teroris didasarkan pada komunikasi dan informasi. Itu juga pasti akan berubah.

Teroris adalah pengadopsi teknologi awal. Contoh terbaru melibatkan penyalahgunaan senjata cetak 3D dan mata uang kripto.

Negara Islam menggunakan drone di medan perang Suriah. Selanjutnya, drone murah berkemampuan AI, yang mampu mengirimkan muatan mematikan atau menabrak tempat ramai, mungkin beroperasi dalam kawanan, pasti akan masuk dalam daftar keinginan teroris.

Tentu saja tidak ada yang menyarankan bahwa komputer harus dibatasi seperti bahan kimia tertentu yang dapat digunakan dalam bom. Jika seseorang menggunakan teknologi AI untuk terorisme, mereka melakukan pelanggaran.

Pertanyaan kuncinya bukanlah penuntutan tetapi pencegahan, dan apakah kemungkinan penyalahgunaan AI merupakan tatanan baru ancaman teroris.

Saat ini, ancaman teroris di Inggris Raya (Irlandia Utara berbeda) terkait dengan serangan tingkat rendah menggunakan pisau atau kendaraan.

Tapi serangan yang didukung AI mungkin sudah dekat.

Saya tidak punya jawaban, tetapi tempat yang baik untuk memulai adalah kejujuran yang lebih besar tentang kemampuan baru ini. Secara khusus, kejujuran dan transparansi yang lebih besar tentang perlindungan apa yang ada dan, yang terpenting, tidak ada.

Ketika, dalam sebuah latihan, saya bertanya kepada ChatGPT bagaimana cara mengecualikan penggunaan teroris, ia menjawab bahwa pengembangnya, OpenAI, melakukan ‘pemeriksaan latar belakang ekstensif terhadap pengguna potensial’.

Setelah saya mendaftar dalam waktu kurang dari satu menit, ini terbukti salah.

Kegagalan lainnya adalah platform mengacu pada syarat dan ketentuannya tanpa menentukan siapa dan bagaimana mereka ditegakkan.

Misalnya, berapa banyak moderator yang berdedikasi untuk menandai kemungkinan penggunaan teroris? 10, 100, 1.000? Bahasa apa yang mereka gunakan? Apakah mereka melaporkan potensi terorisme kepada FBI dan Polisi Penanggulangan Terorisme di Inggris? Apakah mereka memberi tahu pasukan polisi setempat di tempat lain di dunia?

Jika masa lalu adalah panduan, sumber daya manusia untuk menangani masalah ini sangat sedikit.

Kebenaran yang mengerikan adalah bahwa ChatGPT, seperti semua ‘keajaiban’ online lainnya yang dapat, dan akan, disalahgunakan untuk tujuan teroris, akan menimbulkan risiko, seperti yang selalu dilakukan oleh perusahaan teknologi ini, pada masyarakat yang lebih luas.

Ini akan menjadi tanggung jawab individu untuk mengatur perilaku mereka, dan orang tua untuk mengawasi anak-anak mereka.

Kami melepaskan internet pada anak-anak kami tanpa persiapan yang tepat. Kebisingan yang meyakinkan tentang pedoman dan standar etika yang ketat tidak akan hilang.

Tidak mengkhawatirkan untuk memikirkan risiko teroris yang ditimbulkan oleh AI.

Rctiplus.com

Rctiplus.com pewartanusantara.com

pewartanusantara.com Jobnas.com

Jobnas.com Serikatnews.com

Serikatnews.com Langgar.co

Langgar.co Beritautama.co

Beritautama.co Gubuktulis.com

Gubuktulis.com surau.co

surau.co