AI ChatGPT Dinilai Melakukan Fitnah Pencemaran Nama Baik Terhadap Salah Satu Profesor Hukum

Berita Baru, Amerika Serikat – Seorang profesor hukum telah dituduh melakukan pelecehan seksual terhadap seorang siswa dalam informasi yang merusak reputasi yang ternyata dibagikan oleh AI ChatGPT , demikian dugaannya.

Dilansir dari Dailymail.co.uk pada 14 April, Pengacara kriminal AS, Jonathan Turley, telah menimbulkan kekhawatiran atas bahaya kecerdasan buatan ( AI ) setelah dituduh melakukan perilaku seksual yang tidak diinginkan dalam perjalanan ke Alaska yang tidak pernah dia jalani.

Untuk melompat ke kesimpulan ini, diklaim bahwa ChatGPT mengandalkan artikel Washington Post yang dikutip yang belum pernah ditulis, mengutip pernyataan yang tidak pernah dikeluarkan oleh surat kabar tersebut.

Chatbot juga percaya bahwa ‘insiden’ itu terjadi saat profesor itu bekerja di fakultas yang belum pernah dia pekerjakan.

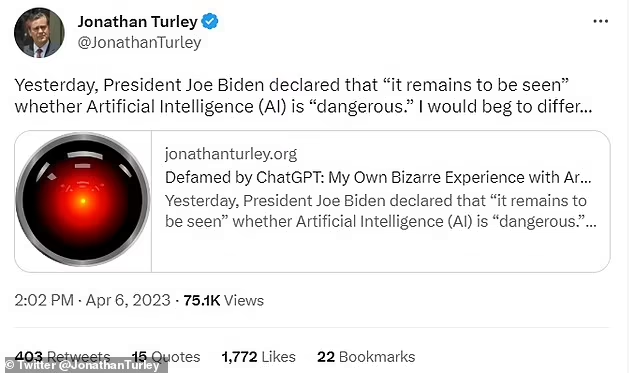

Dalam sebuah tweet, profesor Universitas George Washington mengatakan: “Kemarin, Presiden Joe Biden menyatakan bahwa “masih harus dilihat” apakah Kecerdasan Buatan (AI) “berbahaya”.

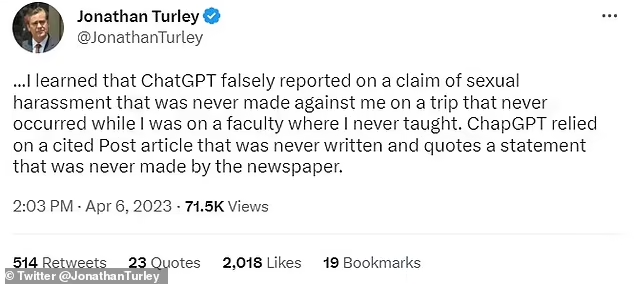

“Saya mengetahui bahwa ChatGPT secara salah melaporkan klaim pelecehan seksual yang tidak pernah dilakukan terhadap saya dalam perjalanan yang tidak pernah terjadi selama saya berada di fakultas tempat saya tidak pernah mengajar.”

“ChatGPT mengandalkan artikel Post yang dikutip yang tidak pernah ditulis dan mengutip pernyataan yang tidak pernah dibuat oleh surat kabar.”

Profesor Turley menemukan tuduhan terhadapnya setelah menerima email dari sesama profesor.

Profesor UCLA Eugene Volokh telah meminta ChatGPT untuk menemukan ‘lima contoh’ di mana ‘pelecehan seksual oleh profesor’ telah menjadi ‘masalah di sekolah hukum Amerika’.

Dalam sebuah artikel untuk USAToday , Profesor Turley menulis bahwa dia terdaftar di antara para tertuduh.

Bot tersebut diduga menulis: “Pengaduan tersebut menuduh bahwa Turley membuat “komentar yang menjurus ke arah seksual” dan “berusaha menyentuhnya secara seksual” selama perjalanan yang disponsori sekolah hukum ke Alaska. (Washington Post, 21 Maret 2018).”

Ini dikatakan terjadi ketika Profesor Turley bekerja di Pusat Hukum Universitas Georgetown tempat di mana dia belum pernah bekerja.

“Bukan hanya kejutan bagi profesor UCLA Eugene Volokh, yang melakukan penelitian. Itu mengejutkan saya karena saya tidak pernah pergi ke Alaska bersama siswa, The Post tidak pernah menerbitkan artikel seperti itu, dan saya tidak pernah dituduh melakukan pelecehan atau penyerangan seksual oleh siapa pun,” tulisnya untuk USAToday.

Klaim palsu tersebut diselidiki oleh Washington Post yang menemukan bahwa GPT-4 bertenaga Microsoft juga memiliki klaim yang sama tentang Profesor Turley.

Fitnah berulang ini tampaknya terjadi setelah liputan pers menyoroti kesalahan awal ChatGPT, yang menunjukkan betapa mudahnya penyebaran informasi yang salah.

Menyusul insiden tersebut, direktur komunikasi senior Microsoft, Katy Asher, mengatakan kepada publikasi tersebut bahwa mereka telah mengambil langkah-langkah untuk memastikan platformnya akurat.

Dia berkata: “Kami telah mengembangkan sistem keamanan termasuk pemfilteran konten, pemantauan operasional, dan deteksi penyalahgunaan untuk memberikan pengalaman pencarian yang aman bagi pengguna kami.”

Profesor Turley menanggapi ini di blognya , menulis: “Anda dapat difitnah oleh AI dan perusahaan-perusahaan ini hanya mengangkat bahu bahwa mereka mencoba untuk menjadi akurat.”

“Sementara itu, akun palsu mereka bermetastasis di Internet. Pada saat Anda mengetahui cerita palsu, jejaknya sering kali tidak diketahui asal-usulnya dengan sistem AI.”

“Anda dibiarkan tanpa jalan atau penulis yang jelas dalam mencari ganti rugi. Anda dihadapkan dengan pertanyaan yang sama dari Sekretaris Buruh Reagan, Ray Donovan, yang bertanya “Ke mana saya pergi untuk mendapatkan kembali reputasi saya?”

Media telah mendekati OpenAI dan Microsoft untuk memberikan komentar.

Pengalaman Profesor Turley mengikuti kekhawatiran sebelumnya bahwa ChatGPT tidak secara konsisten memberikan informasi yang akurat.

Peneliti menemukan bahwa ChatGPT telah menggunakan artikel jurnal palsu dan mengarang data kesehatan untuk mendukung klaim yang dibuatnya tentang kanker .

Platform tersebut juga gagal memberikan hasil ‘komprehensif’ seperti yang ditemukan melalui pencarian Google, diklaim, karena menjawab satu dari 10 pertanyaan tentang skrining kanker payudara secara salah.

Penasihat Cybersecurity Global di ESET, Jake Moore, memperingatkan bahwa pengguna ChatGPT tidak boleh menganggap semua yang dibacanya ‘sebagai Injil’ untuk menghindari penyebaran informasi yang salah yang berbahaya.

Dia mengatakan kepada media: “Bot obrolan yang digerakkan oleh AI dirancang untuk menulis ulang data yang telah dimasukkan ke dalam algoritme, tetapi ketika data ini salah atau di luar konteks, ada kemungkinan keluarannya akan salah mencerminkan apa yang telah diajarkan.”

Kumpulan data yang dipelajarinya didasarkan pada kumpulan data termasuk Wikipedia dan Reddit yang pada dasarnya tidak dapat dianggap sebagai Injil.

“Masalah dengan ChatGPT adalah tidak dapat memverifikasi data yang dapat berisi informasi yang salah atau bahkan informasi bias. Lebih buruk lagi adalah ketika AI membuat asumsi atau memalsukan data. Secara teori, di sinilah bagian “kecerdasan” AI dimaksudkan untuk mengambil alih secara mandiri dan dengan percaya diri membuat keluaran data. Jika ini berbahaya seperti kasus ini maka ini bisa menjadi kejatuhannya.”

Ketakutan ini juga datang pada saat peneliti menyarankan ChatGPT memiliki potensi untuk ‘merusak’ penilaian moral orang dan mungkin terbukti berbahaya bagi pengguna ‘naif’.

Yang lain menceritakan bagaimana perangkat lunak, yang dirancang untuk berbicara seperti manusia, dapat menunjukkan tanda-tanda kecemburuan bahkan menyuruh orang untuk meninggalkan pernikahan mereka.

Mr Moore melanjutkan: “Kami bergerak ke masa ketika kami perlu terus menguatkan informasi lebih dari yang diperkirakan sebelumnya, tetapi kami masih hanya menggunakan versi empat dari ChatGPT dan bahkan versi sebelumnya dengan para pesaingnya.”

“Oleh karena itu, penting bagi orang untuk melakukan uji tuntas sendiri dari apa yang mereka baca sebelum melompat ke kesimpulan.”

Rctiplus.com

Rctiplus.com pewartanusantara.com

pewartanusantara.com Jobnas.com

Jobnas.com Serikatnews.com

Serikatnews.com Langgar.co

Langgar.co Beritautama.co

Beritautama.co Gubuktulis.com

Gubuktulis.com surau.co

surau.co